近日,数据科学学院于彬教授团队在自然语言处理研究领域取得重要进展,相关成果以“Graph convolutional network based on self-attention variational autoencoder and capsule contrastive learning for aspect-based sentiment analysis”为题发表在人工智能领域的顶级期刊Expert Systems With Applications (中科院一区TOP期刊,影响因子7.5)。于彬教授为论文的通讯作者,2022级研究生王馨月为第一作者,青岛科技大学为第一完成单位。

方面级情感分析(Aspect-based Sentiment Analysis, ABSA)是自然语言处理领域中的一个关键研究方向,其核心目标是识别文本中特定方面的情感倾向。与传统的整体情感分析相比,ABSA不仅关注整体的情感倾向,而且更加注重对文本中具体方面进行情感识别。这种细粒度的分析能够帮助企业更深入地了解消费者对产品或服务的各个维度的评价,从而为产品迭代、服务改进和市场调整策略提供有力的支持。尽管ABSA领域已取得显著进展,但由于语言表达的多样性,在实际应用中仍存在许多问题。大多数现有的方法严重依赖于依存句法树进行句法分析,这不仅忽略语义信息的完整性,还会导致全局信息的丢失。此外,文本中存在许多隐含信息线索和长距离依赖关系难以捕捉和理解,这些信息对于准确理解文本的情感信息至关重要。因此,构建一个可以同时利用深层次语义和句法信息,并有效探索单词之间的隐含和复杂依赖关系的ABSA模型仍是一个充满挑战的研究问题。

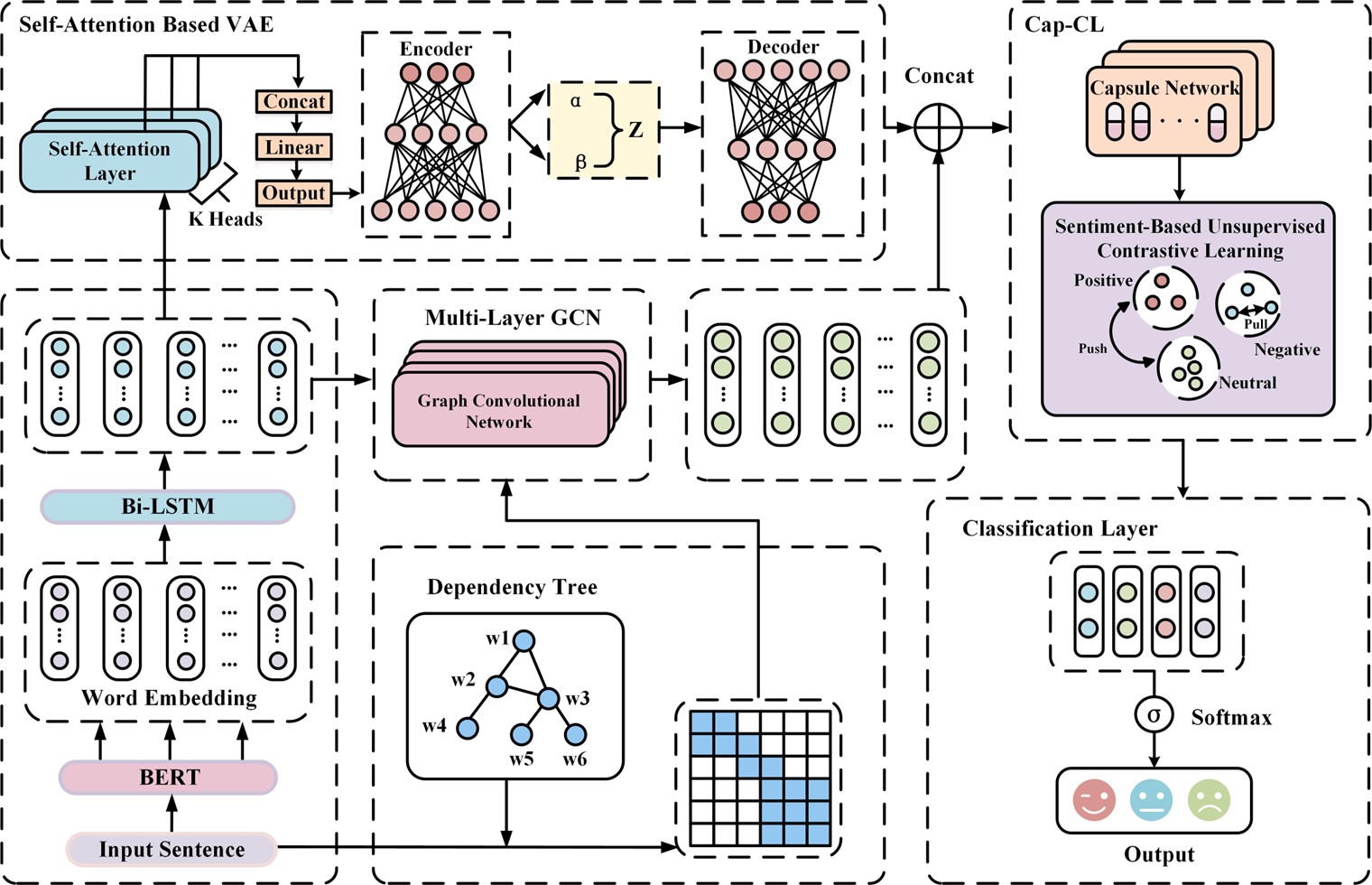

本研究提出一种集成改进的变分自编码器(Variational Autoencoder, VAE)和对比学习模块的图卷积网络(Graph Convolutional Network, GCN),名为SVCCL-GCN。具体来说,该模型首先使用BERT和Bi-LSTM来获取上下文嵌入表示。其次,利用句法依存树和GCN构建一个基于句法的GCN模块,以挖掘方面词与上下文之间的句法关系。此外,本研究定义一种新的VAE变体SA-VAE,将自注意力机制融入到VAE的编码器部分。这使得模型能够准确获取方面词和情感词之间的长距离依赖关系,并在提取局部特征的同时兼顾数据的全局信息。最后,首次提出一种基于胶囊网络的对比学习方法,其中胶囊网络的输出被进一步处理为对比学习特征,进一步提取与方面相关的丰富语义信息,增强模型对隐含和复杂语义情感特征的理解能力。本研究在Restaurant14、Laptop14、Twitter、Restaurant15和Restaurant16这五个基准数据集上进行一系列实验,以评估所提出模型的性能。此外,还通过案例分析以及注意力可视化技术对预测结果进行深入的可解释性分析。实验结果表明,SVCCL-GCN在ABSA任务中表现出显著的优势,有效提升对情感极性预测的准确性。

文章链接:https://doi.org/10.1016/j.eswa.2025.127172

以上研究得到国家自然科学基金面上项目和山东省自然科学基金面上项目的资助。